近日,软件学院举办“智能・软件・未来”论坛第16期、第17期,邀请澳大利亚悉尼大学博士生李亭慧和英国兰卡斯特大学的博士生王昊鹏分别作题为“理解并建模情境障碍对混合现实交互的影响”和“基于头动-眼动协同的多模态3D用户界面输入”的学术报告。

李亭慧介绍了其在混合现实领域关于情境性障碍(Situational Impairments)的系统研究。随着MR设备日益普及,用户在真实使用环境中可能面临光照变化、姿态受限、注意力分散等多种情境障碍,这些因素会显著影响交互性能和任务完成效率。报告展示了她所构建的基于计算建模的量化评估体系,用以揭示不同情境障碍对MR交互性能的潜在机制,并提出了能够自动检测障碍状态并进行自适应调整的智能交互模型。该研究为提升混合现实技术在多样化使用场景下的可用性与用户体验提供了理论与实践支持。

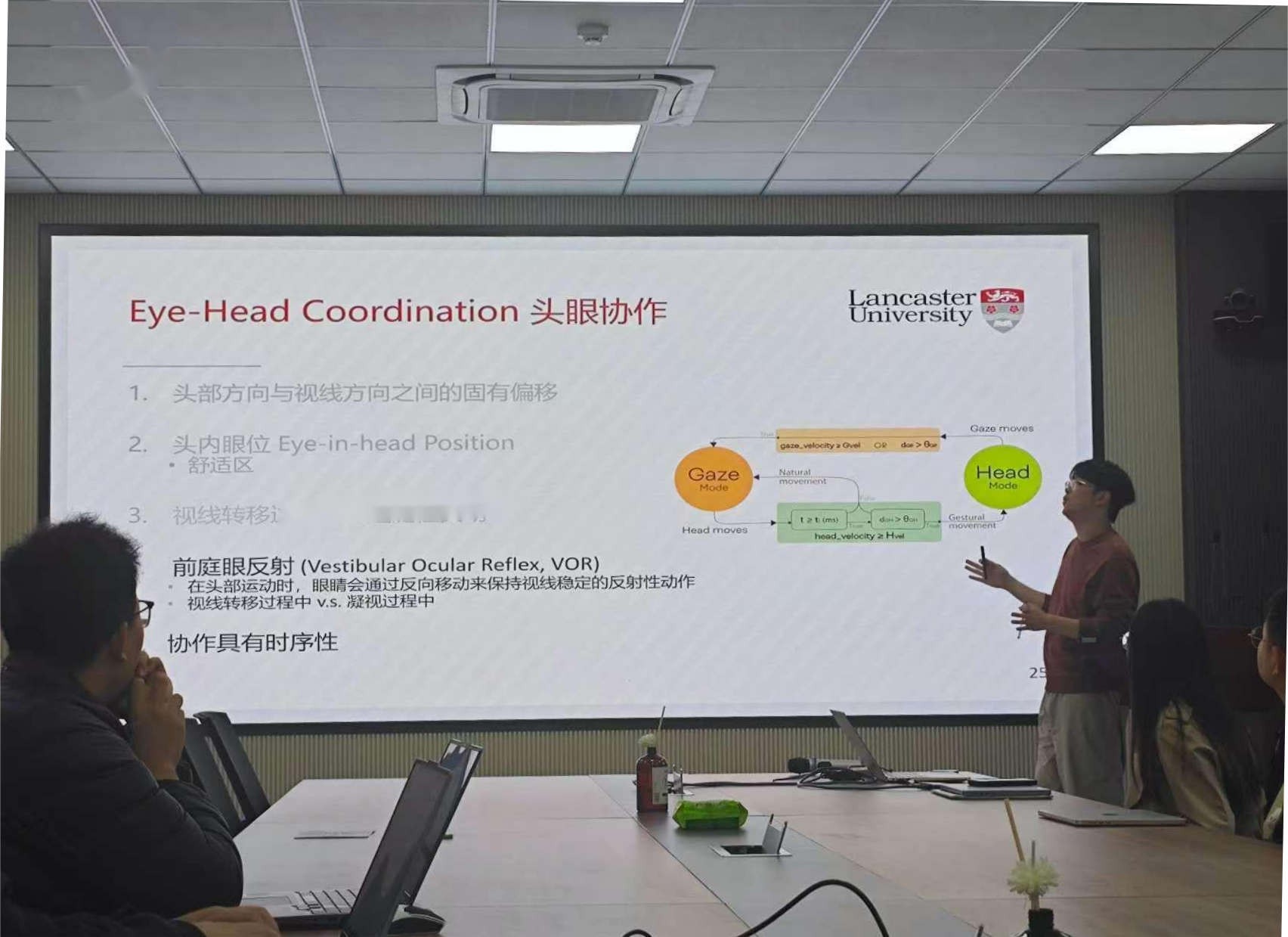

王昊鹏围绕头动与眼动协同(Eye-Head Coordination)的多模态输入设计展开讲解。他介绍了头部运动作为VR与AR设备中基础交互方式的重要性,并分析了头动与眼动在自然交互过程中的耦合关系,以及如何通过协同建模优化3D空间中的注视交互精度与舒适性,实现更自然、更高效的人机交互。报告提出的交互原型在提升远距离操作可达性与无障碍情境下的交互可靠性方面表现突出,为多模态输入系统的发展提供了新思路。

李亭慧,澳大利亚悉尼大学博士生,研究方向为人机交互、混合现实与生物力学建模,曾在CHI、UIST与UbiComp等国际顶级会议发表论文,并获得CHI’25最佳论文荣誉奖。

王昊鹏,英国兰卡斯特大学博士生,研究方向为3D用户界面中的多模态自然交互输入,参与欧洲ERC高级研究项目“GEMINI: Gaze and Eye Movement Interaction”,在ACM TOCHI、IEEE VR等国际会议上发表多篇论文。

(文/图:沈益冉 责任编辑:高艳博)